ChatGPT、Claude、画像生成AI、業務効率化など

AI活用

AI活用 バイトテロはAIで防げる?SNS監視と企業リスク管理の最前線を調べてみた

最近、またSNSで飲食店のアルバイト店員による不適切な動画が話題になっているのを見かけました。いわゆる「バイトテロ」ってやつですね。一時期すごく騒がれて、最近は落ち着いたのかなと思っていたんですが、どうやらそうでもないみたいです。スマートフ...

AI活用

AI活用 SNS写真の写り込みが怖い!AI解析リスクと鉄壁の防御術

最近、SNSに写真をアップするとき、ちょっとした不安を感じることってありませんか?「この背景、大丈夫かな?」「何か変なもの写ってないかな?」って。僕も以前はあまり気にせず食事の写真とか風景を投稿していたんですが、最近のニュースや技術の進化を...

AI活用

AI活用 ホークアイ全球団導入!AIが変えるプロ野球の未来と新観戦体験

最近、テレビでプロ野球中継を見ていると、画面に表示される情報がすごく増えたなーって感じませんか?球速だけじゃなくて、投球の回転数とか、打球の角度とか。「これ、どうやって測ってるの?」って不思議に思うような細かいデータがリアルタイムで出てきま...

AI活用

AI活用 Gemma4 vs Qwen3.6:コードデバッグにおける「思考機能」の差を検証した結果

Gemma4 vs Qwen3.6:コードデバッグにおける「思考機能」の差を検証した結果

はじめに:なぜこの検証を行ったのか

本検証は、Open WebUI向けにPandasAIを活用したデータ分析ツールを開発していた際に発生した不具合につ...

AI活用

AI活用 1-bitモデルは実用的か?Bonsai 8B vs Gemma 4 E2B をRAG連携で徹底比較

超軽量1.28GBの1-bit量子化モデル「Bonsai 8B」と、3.37GBの4-bit量子化「Gemma 4 E2B」をRAG連携タスクで比較検証。iOSやApple Siliconでのローカル推論を想定し、知識系Q&A・RAGソース活用・回答の具体性を評価。結論として、1-bitモデルは技術デモとしては興味深いが、実用にはサイズ差2.6倍でも4-bitモデルが圧勝。

AI活用

AI活用 ローカルLLM思考モード対決:Qwen 3.5 vs Gemma 4 – 桜の開花と交通情報で比較

はじめに

最新のローカルLLMには「思考モード(Thinking Mode)」が搭載されています。回答前に内部で推論プロセスを実行し、より正確な回答を導き出す機能です。

今回は、コーディング以外のタスクでQwen 3.5とGemma 4...

AI活用

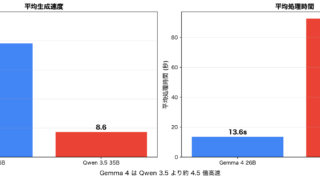

AI活用 Gemma 4 vs Qwen 3.5 画像認識ベンチマーク — Apple Silicon ローカルVLM比較【2026年4月】

Apple M1 Max上でGemma 4 26BとQwen 3.5 35Bの画像認識性能を比較。vllm-mlxを使用し、速度・品質を3つのテスト画像で検証。Gemma 4が約4.5倍高速で品質も上回る結果に。2026年4月版。

AI活用

AI活用 OllamaのMLX対応で本当に乗り換えるべき? mlx-lm.serverとQwen 3.5で比較してみた

OllamaのMLX対応は本当に速いのか。Mac M1 MaxでQwen 3.5を使い、mlx-lm.serverと速度・品質・運用性を比較した実測ベースの記事。

AI活用

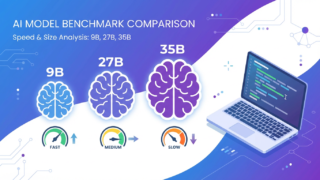

AI活用 Qwen 3.5コーディング支援ベンチマーク — 9B/27B/35B MoEを実務タスクで比較した結果

Qwen 3.5の9B Dense、27B Dense、35B A3B(MoE)をMacBook ProでTodoアプリ生成タスクで比較。思考ON/OFFの品質差、MoEの真価、27Bが過大評価だった理由を実データで解説。

AI活用

AI活用 森保ジャパンの歴史的勝利を支えたAI分析とデータサッカーの裏側

あのカタールW杯の熱狂、まだ記憶に新しいですよね。ドイツとスペインという優勝候補を次々と破った、あの歴史的なジャイアントキリング。当時は日本中で「奇跡」なんて言われて大盛り上がりでしたが、どうやらあれは単なる奇跡や運だけじゃなかったみたいな...