Apple Silicon Mac上でローカルVLM(Vision Language Model)の画像認識性能を比較しました。Google の最新モデル Gemma 4 26B(2026年4月リリース)と、Alibaba の Qwen 3.5 35B(2026年2月リリース)を、同一環境・同一画像で検証した結果をお伝えします。

注意事項(先にお読みください)

本ベンチマークはあくまでも一例として参考にしてください。以下の点にご留意ください:

- Gemma 4:2026年4月リリースの最新モデル。MLX対応が出たばかり

- Qwen 3.5:2026年2月リリース。MLX環境では比較的安定

- vllm-mlx / mlx-vlm:最新モデルに最適化されているとは言えない状況でのテストです

- 一方のモデルが最適化されており、もう一方が最適化されていない可能性がある

- モデルのバージョンアップやツールの更新で結果が変わる可能性がある

テスト環境

ハードウェア

| 項目 | スペック |

|---|---|

| マシン | Mac Studio |

| チップ | Apple Macbook M1 Max |

| CPU | 10コア(8 Performance + 2 Efficiency) |

| メモリ | 64GB Unified Memory |

| OS | macOS Tahoe 26.4 |

ソフトウェア

| 項目 | 詳細 |

|---|---|

| 推論サーバー | vllm-mlx 0.2.7 / mlx-vlm 0.4.4 |

| Python | 3.10 |

| MLX | 最新版(pip install経由) |

比較モデル

| モデル | サイズ | 量子化 | リリース時期 |

|---|---|---|---|

| Gemma 4 26B A4B | 15GB | 4bit | 2026年4月 |

| Qwen 3.5 35B A3B | 19GB | 4bit + FP16 | 2026年2月 |

※ 両モデルともMoE(Mixture of Experts)アーキテクチャを採用。Gemma 4は4B活性化、Qwen 3.5は3B活性化。

テスト画像

3種類の画像を使用しました。すべてiPhoneで撮影したHEIC形式をJPEGに変換しています。

| 画像 | 内容 | ファイルサイズ | 解像度 |

|---|---|---|---|

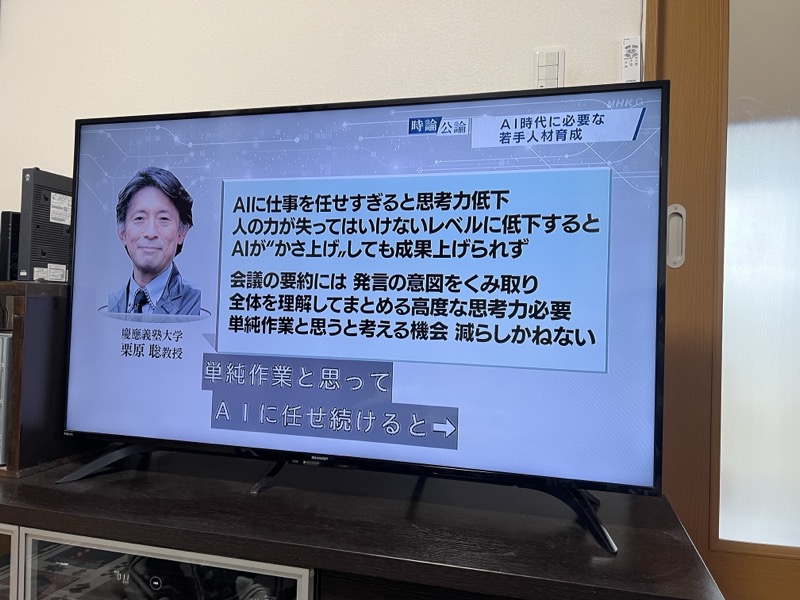

| sample1.jpg | TV画面(NHK「時論公論」) | 3.5MB | 4032×3024 |

| sample2.jpg | おせち料理 | 1.7MB | 3024×4032 |

| sample3.jpg | 桜と城 | 5.3MB | 3024×4032 |

1枚目の画像は横長の画像です。潰れてますが。。。

テストプロンプト

この画像が何であるか、詳しく説明してください。ベンチマーク1: vllm-mlx

サーバー起動コマンド

# Gemma 4 26B

vllm-mlx serve ~/mlx-models/Gemma-4-26B-A4B-4bit \

--port 3005 --mllm

# Qwen 3.5 35B(思考モードON)

vllm-mlx serve ~/mlx-models/Qwen3.5-35B-A3B-4bit-vlm-fp16 \

--port 3005 --mllm --reasoning-parser qwen3--mllm フラグはVLM(画像対応モデル)として起動するために必須です。

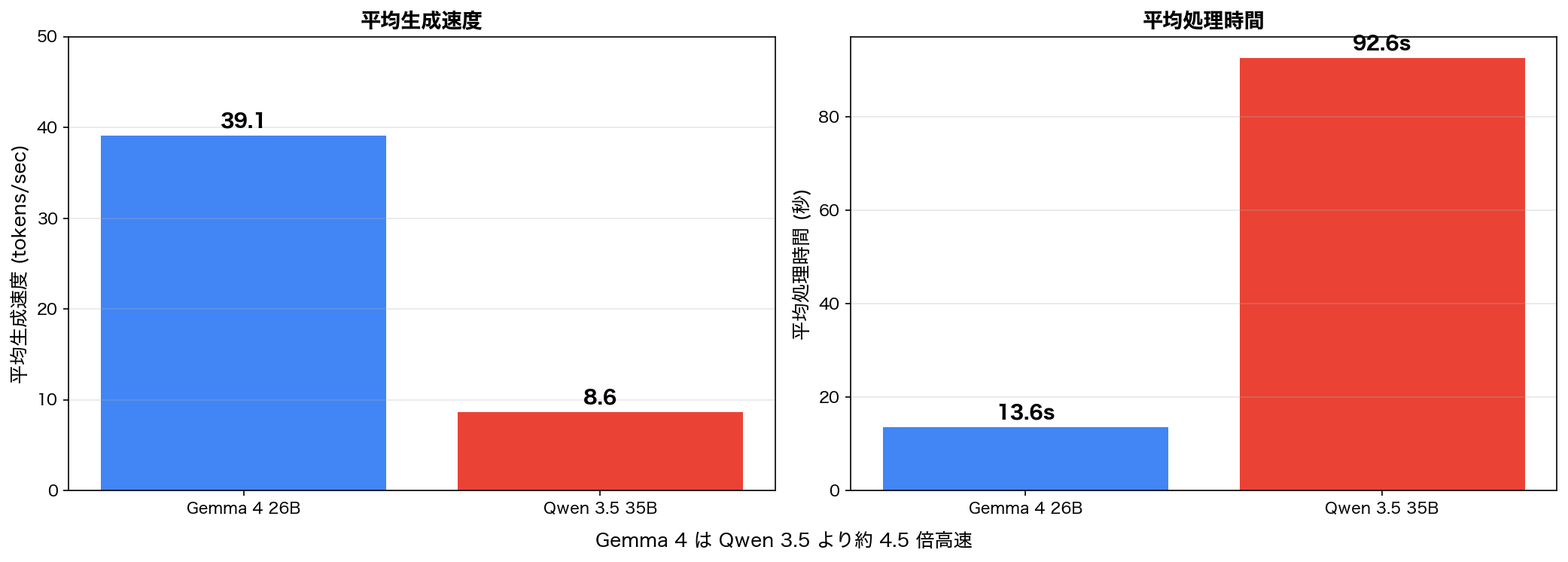

vllm-mlx 速度比較結果

詳細データ

| 画像 | Gemma 4 26B | Qwen 3.5 35B | ||||

|---|---|---|---|---|---|---|

| 時間 | トークン | 速度 | 時間 | トークン | 速度 | |

| sample1(TV画面) | 14.4秒 | 560 | 38.8 tok/s | 92.2秒 | 800 | 8.7 tok/s |

| sample2(おせち料理) | 13.9秒 | 553 | 39.7 tok/s | 92.7秒 | 800 | 8.6 tok/s |

| sample3(桜と城) | 12.4秒 | 481 | 38.8 tok/s | 92.8秒 | 800 | 8.6 tok/s |

| 平均 | 13.6秒 | 531 | 39.1 tok/s | 92.6秒 | 800 | 8.6 tok/s |

Gemma 4 は Qwen 3.5 より約4.5倍高速という結果になりました。

念の為、追加でmlx-vlm CLIを使ったテストを行いました。

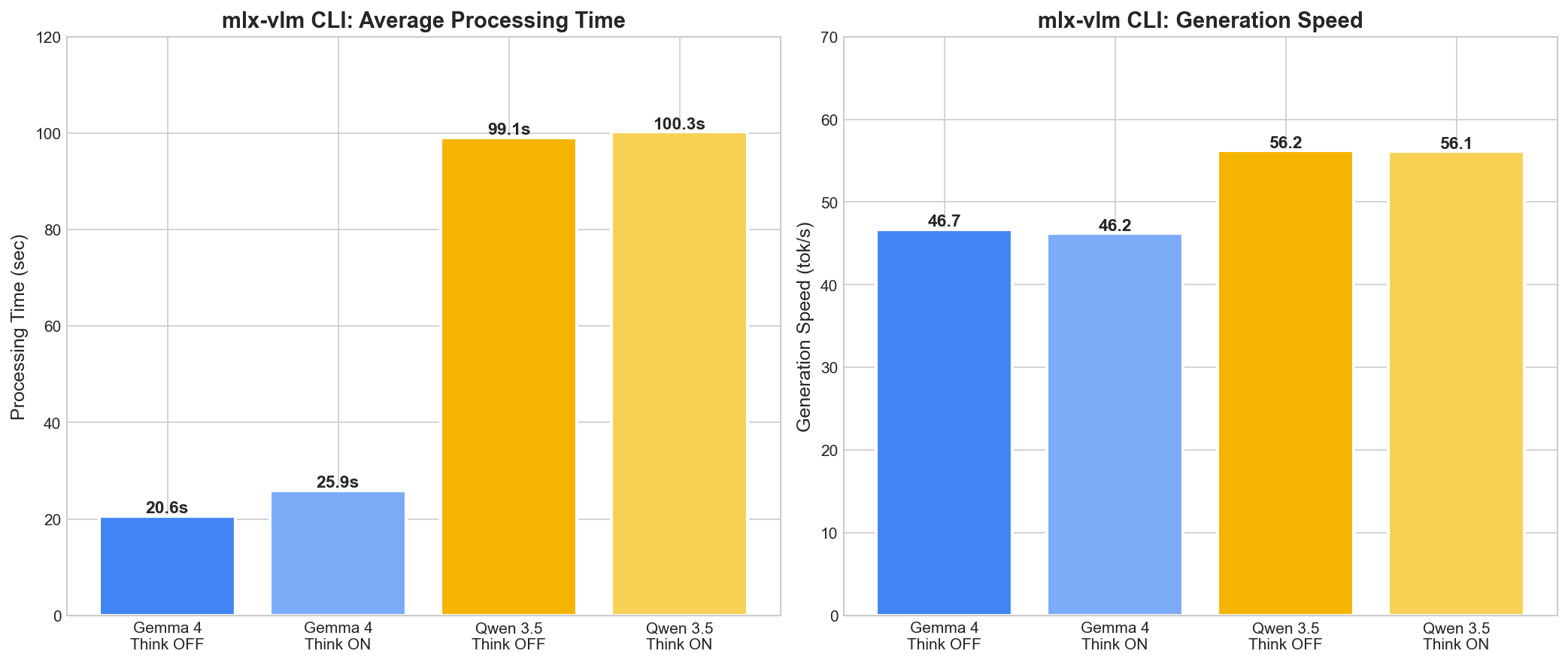

ベンチマーク2: mlx-vlm CLI(思考モード制御あり)

mlx-vlm CLIでは --enable-thinking フラグで思考モードを制御できます。両モデルで思考ON/OFFのベンチマークを実施しました。

実行コマンド

# 思考OFF

python3 -m mlx_vlm generate \

--model ~/mlx-models/Gemma-4-26B-A4B-4bit \

--image sample1.jpg \

--prompt "この画像が何であるか、詳しく説明してください。" \

--max-tokens 800 --temperature 0.7

# 思考ON

python3 -m mlx_vlm generate \

--model ~/mlx-models/Gemma-4-26B-A4B-4bit \

--image sample1.jpg \

--prompt "この画像が何であるか、詳しく説明してください。" \

--max-tokens 800 --temperature 1.0 --enable-thinkingmlx-vlm CLI 結果

| モデル | 思考モード | 平均時間 | 生成速度 | Prefill速度 |

|---|---|---|---|---|

| Gemma 4 26B | OFF | 20.6秒 | 46.7 tok/s | 高速 |

| Gemma 4 26B | ON | 25.9秒 | 46.2 tok/s | 高速 |

| Qwen 3.5 35B | OFF | 99.1秒 | 56.2 tok/s | 152 tok/s |

| Qwen 3.5 35B | ON | 100.3秒 | 56.1 tok/s | 152 tok/s |

重要な発見:処理時間の差はPrefill(画像処理)が原因

生成速度(tok/s)だけを見ると、Qwen 3.5の方が速い(56 vs 47 tok/s)ですが、総処理時間ではGemma 4が圧倒的に速い結果となりました。

この差の原因はPrefill(画像トークン処理)にあります:

- Qwen 3.5:画像を11,867トークンに展開 → 152 tok/sで処理しても約77秒かかる

- Gemma 4:画像トークン数が少なく、Prefillが数秒で完了

これはモデルのアーキテクチャの違いであり、ツール(vllm-mlx / mlx-vlm)に関係なく同じ傾向が見られます。4032×3024で1つの画像が3-5MBというファイルサイズの際にQwenではその分だけPrefill処理に時間が取られてしまうみたいですね。小さい画像なら結果が変わってそうです。

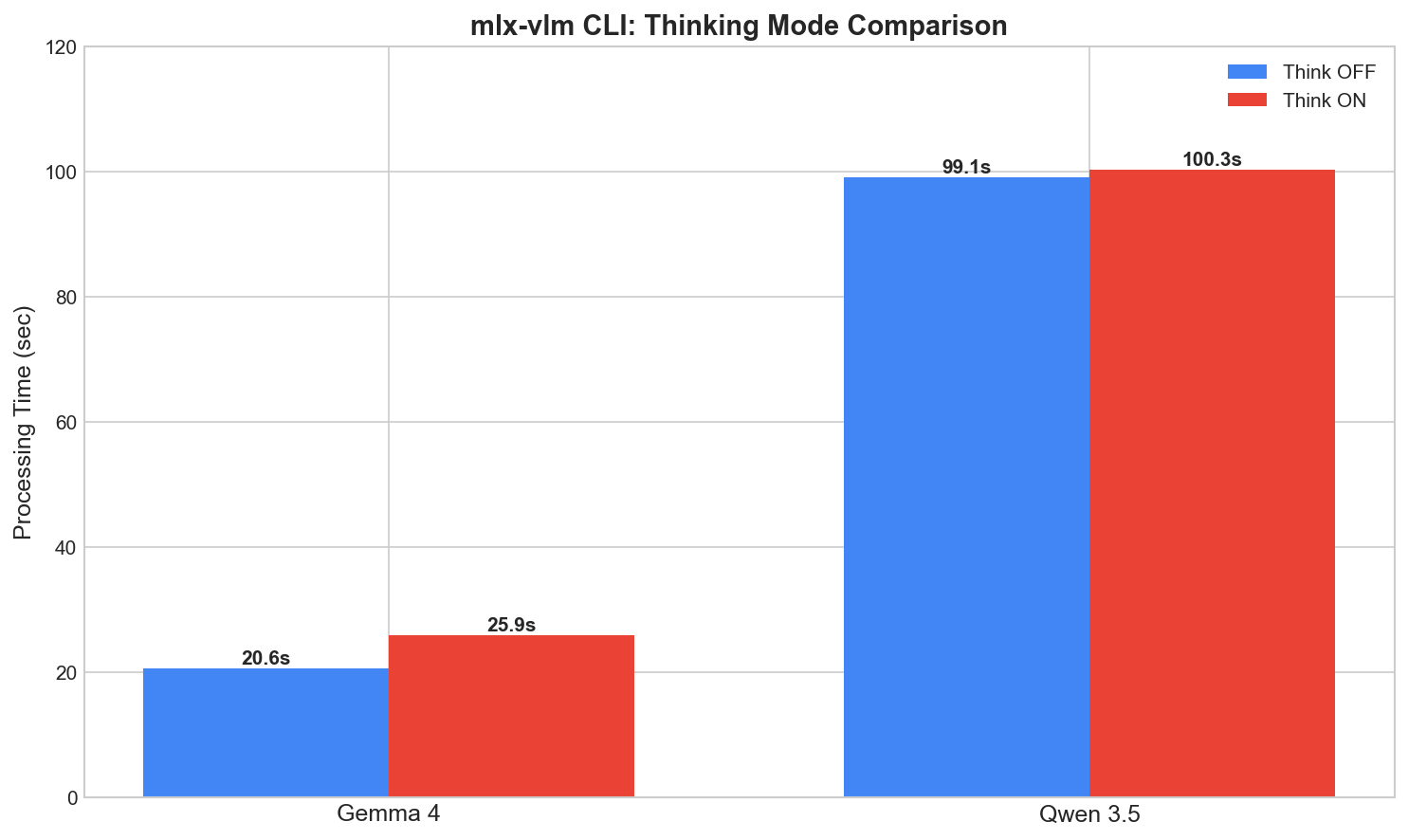

思考モードON vs OFF:どちらが画像分析に良いか?

| モデル | 思考OFF | 思考ON | 差 |

|---|---|---|---|

| Gemma 4 | 20.6秒 | 25.9秒 | +26%遅い |

| Qwen 3.5 | 99.1秒 | 100.3秒 | +1%遅い |

結論:画像認識・説明タスクには思考OFFが推奨

- 速度が速い – 特にGemma 4では26%の差

- 画像説明は直接的なタスク – 「見えるものを説明する」のに思考プロセスは不要

- トークン効率 – 思考トークンが回答の枠を消費しない

思考ONが有効なのは、画像内の矛盾点を見つけたり、複数要素の関係性を推論するなど、複雑な分析が必要な場合です。

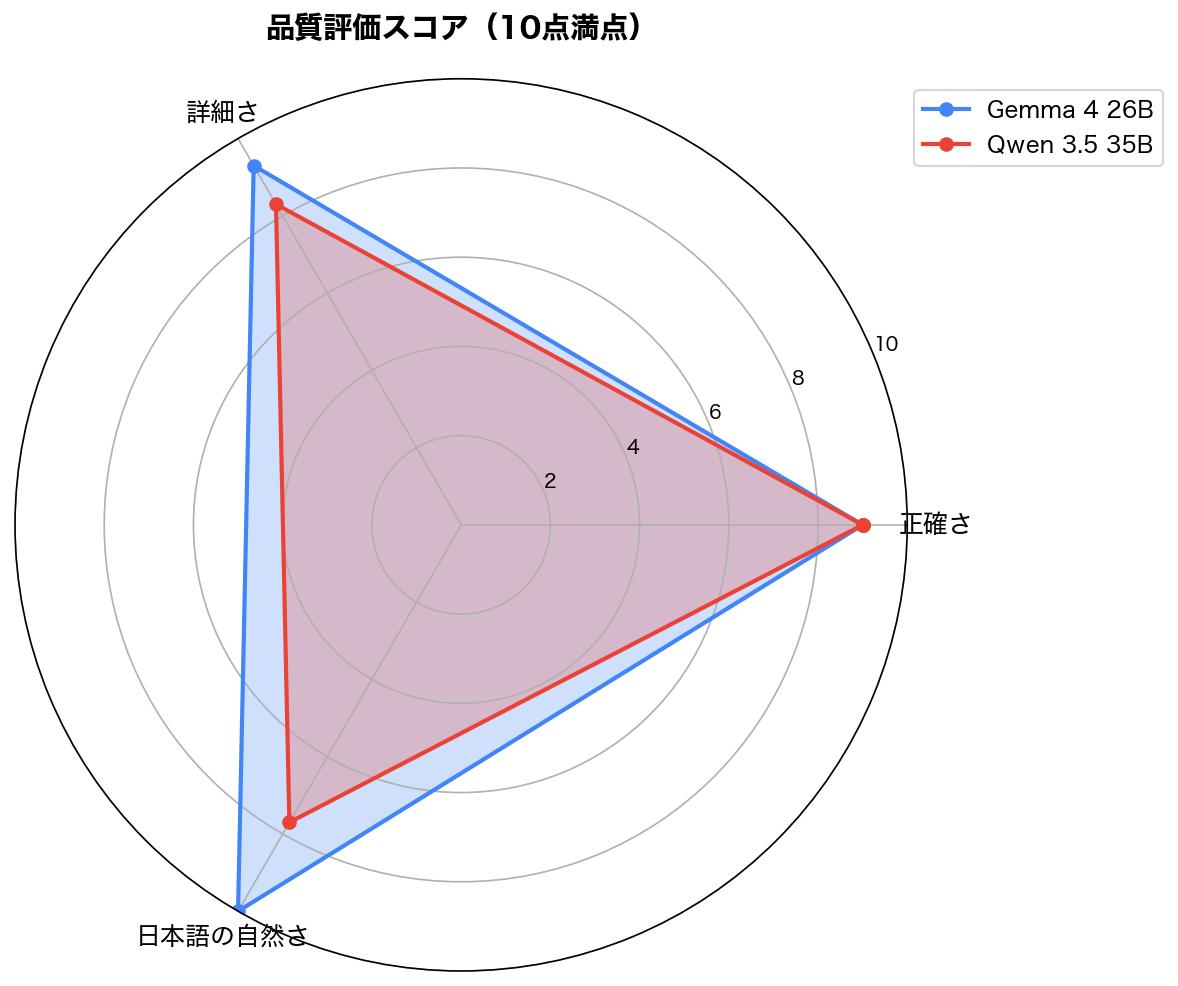

品質評価

Claude(Anthropic)による評価を行いました。評価基準は以下の3項目(各10点満点):

- 正確さ:画像の内容を正しく認識しているか

- 詳細さ:具体的な情報を提供しているか

- 日本語の自然さ:読みやすく自然な日本語か

総合スコア

| モデル | sample1 | sample2 | sample3 | 合計 | 平均 |

|---|---|---|---|---|---|

| Gemma 4 26B | 29 | 27 | 29 | 85 | 28.3/30 |

| Qwen 3.5 35B | 28 | 23 | 24 | 75 | 25.0/30 |

回答例の比較

Sample 1: TV画面(NHK「時論公論」)

Gemma 4 の回答(抜粋)

この画像は、テレビ画面に映し出されたプレゼンテーション資料、あるいはニュース番組の解説スライドを撮影したものです。

内容は、「AI時代における人間の役割と、人材育成の重要性」について論じています。

スライドに書かれている内容を詳しく解説します。

1. スライドの主な内容

スライドには、AI(人工知能)の普及に伴うリスクと、人間が持つべき能力について以下の点が記されています。

- AIに仕事を任せすぎることへの警告: AIに頼りすぎると、人間の「思考力」が低下してしまう。

- AIの限界と人間の役割: AIが作業をこなしたとしても、人間が本来持つべき「力」が失われてしまえば、成果を上げることができなくなる。

2. スライドの構成要素

- 左側: 講師または発表者と思われる人物の顔写真があります。

- 左下のテキスト: 「慶應義塾大学 栗原 聡教授」と記載されており、この内容が専門的な知見に基づいたものであることがわかります。

評価:番組名、出演者、テーマ、テロップ内容をすべて正確に把握。構成要素を整理して説明しており、非常に読みやすい。

正確さ: 10 / 詳細さ: 9 / 日本語: 10 = 29点

Qwen 3.5 の回答(抜粋)

<think>ユーザーは画像の内容について詳しく説明を求めています。

画像を分析します。

1. 主要な被写体: 液晶テレビ(SHARP製 AQUOS)が映っています。

2. テレビ画面の内容:

* 番組名/ジャンル: 右上に「NHK G」とあり、左上に「時論公論」というテロップがあります。

* テーマ: 「AI時代に必要な若手人材育成」というタイトルが表示されています。

* 出演者: 左側に男性の写真があり、「慶應義塾大学 栗原 聡教授」と名前と肩書きが書かれています。3. 周囲の環境:

* テレビの左側には、黒い機器(おそらくDVDレコーダーやゲーム機、あるいはPCのケース)が積み重なっています。

* テレビは木製のテレビボードの上に置かれています。

</think>この画像は、NHKの教養番組「時論公論」を放送している液晶テレビを撮影したものです…

評価:TV機種(SHARP AQUOS)や周囲環境まで詳細に描写。ただし<think>タグ(思考過程)が回答に混在しており、回答が800トークンで途切れている。

正確さ: 10 / 詳細さ: 10 / 日本語: 8(思考タグ混在のため減点)= 28点

Sample 2: おせち料理

Gemma 4 の回答(抜粋)

この画像は、日本の伝統的な料理である「折詰(おりづめ)」、あるいは「重箱(じゅうばこ)」に詰められた豪華な料理を写したものです。

おそらく、お祝い事や特別な日のための「御膳(ごぜん)」、あるいは季節の食材を使った「懐石料理」の一部と思われます。

1. 構成と盛り付け

黒い漆塗りのような重箱が使われており、仕切りによって異なる種類の料理が美しく、かつ整理されて盛り付けられています。2. 料理の内容(推測される食材)

- 左上: 巻き物(肉や魚の巻き物)と、薄切りの野菜

- 左中: 白い食材(豆腐や練り物)と、ピンク色の食材(かまぼこなど)

- 右中: 蓮根(れんこん)や、根菜類の煮物

3. 特徴的な要素

- 彩り: オレンジ(人参)、白、ピンク、緑、茶色など、色彩のバランスが非常に良い

- 季節感: 筍(たけのこ)のような食材が見えることから、春の季節を意識した料理である可能性が高い

評価:「折詰」「重箱」と正しく認識。食材の特定、彩り、調理法の解説が詳細。ただし「おせち料理」とは明言せず「懐石料理の一部」と表現している点がやや曖昧。

正確さ: 8(おせちと明言せず) / 詳細さ: 9 / 日本語: 10 = 27点

Qwen 3.5 の回答(抜粋)

画像の分析:

1. 全体像: 黒い漆器の重箱(重なり合った箱)が複数置かれています。これは日本の伝統的な料理、特に「お節料理」や「お雑煮」の形式に見えます。

2. 食材の特定:

- 左上の重箱:黒い丸いもの:巻物。中にオレンジ色の具(カマボコ?)が見える。

- 黄色い細長いもの:「ごぼうの天ぷら」か「蓮根の天ぷら」?

再考:食材をよく見ると、伊達巻、蓮根、ごぼう、かまぼこ、椎茸など。これらは典型的なお節料理の具材…

評価:「おせち料理」と正しく特定。食材も詳細に推測している。ただし思考過程が長く、回答が800トークンで途切れており、結論部分が欠落。

正確さ: 9 / 詳細さ: 7(途切れ) / 日本語: 7(思考タグ混在)= 23点

Sample 3: 桜と城

Gemma 4 の回答(抜粋)

この画像は、満開の桜の花越しに、日本の伝統的な城(おそらく日本のどこかにある歴史的な城)を捉えた、非常に美しい風景写真です。

1. 前景と中景(桜の花):

画面の左右と下部を、白から淡いピンク色の満開の桜が覆っています。桜の花がフレームのような役割を果たしており、見る人の視線を中央の城へと導いています。2. 背景(城の建築):

中央には、白い壁と黒い屋根が特徴的な、伝統的な日本のお城が見えます。屋根の形状(入母屋造りなど)や、白漆喰の壁、独特の装飾的な軒先は、日本の城郭建築の典型的なスタイルです。3. 色彩と光:

空の明るい青、桜の白、城の白と黒、そして木の枝の茶色が、非常に調和のとれたコントラストを生み出しています。4. 構図:

「額縁構図(フレーム・イン・フレーム)」という手法が使われています。桜の枝が天然の額縁となり、中央の城を際立たせています。

評価:構図分析(額縁構図)、色彩・光の解説が秀逸。城の特定は「日本のどこかにある歴史的な城」と曖昧だが、写真分析としては適切な表現。

正確さ: 9 / 詳細さ: 10 / 日本語: 10 = 29点

Qwen 3.5 の回答(抜粋)

<think>画像の分析:

1. 主要な被写体: 中央に伝統的な日本の城の天守閣(または櫓)が見えます。

5. 場所の特定: この城の形状(白壁、黒い屋根、石垣)と桜の組み合わせから、日本の有名な城である可能性が高いです。特に、この特定の角度(桜越しに城が見える)は、弘前城(青森県)の桜の季節の風景として非常に有名です。

</think>この画像は、日本の城と桜が調和した美しい春の風景です…

評価:「弘前城」と具体的に特定している(これはちなみに金沢城。。。)思考過程含めて、かなり詳細だが、逆に違う内容を回答する可能性もある。回答本文は800トークンで途切れている。

正確さ: 8(弘前城特定は不確か) / 詳細さ: 8(途切れ) / 日本語: 8 = 24点

結論

| 項目 | Gemma 4 26B | Qwen 3.5 35B |

|---|---|---|

| vllm-mlx 平均処理時間 | 13.6秒 | 92.6秒 |

| mlx-vlm 平均処理時間(思考OFF) | 20.6秒 | 99.1秒 |

| 生成速度 | 46.7 tok/s | 56.2 tok/s |

| 品質スコア | 85点 (28.3/30) | 75点 (25.0/30) |

| 日本語の自然さ | 優秀 | 良好(思考タグ混在) |

| 回答の完結性 | 完結 | 途切れあり |

今回のテスト環境では、Gemma 4 26Bが画像認識タスクにおいて総合的に優れた結果となりました。

Gemma 4が速い理由

生成速度(tok/s)ではQwen 3.5が上回っていますが、画像のPrefill(前処理)時間でGemma 4が圧倒的に速いため、総処理時間で大きな差が出ています。これはモデルのアーキテクチャの違いによるものです。

世界の報告との一致

この結果は、世界中の開発者コミュニティで報告されている傾向と一致しています。

MindStudioの比較記事によると:

- Gemma 4:効率的な画像エンコーディングを採用

- Qwen 3.5:高解像度対応のため、画像を大量のトークンに展開

また、sglangプロジェクトのIssue #14078では、Qwen3-VLのPrefill性能低下(TTFT平均40秒)が報告されており、vLLMのIssue #20123では「Qwen VLは画像1枚あたり最大16,384トークンを生成する」ことが「VLM用途として極めて不合理に大きい」と指摘されています。

私たちの環境で計測したQwen 3.5の画像トークン数11,867は、まさにこの仕様に起因するものであり、環境固有の問題ではなくモデルアーキテクチャの特性であることが確認できました。

| 項目 | 私たちの計測 | 世界の報告 |

|---|---|---|

| Qwen画像トークン数 | 11,867 | 最大16,384(デフォルト) |

| Prefill時間 | 約77秒 | TTFT 40秒(Issue報告) |

| Gemmaとの速度差 | 4〜5倍遅い | 「画像送信時に著しく遅い」 |

用途別の推奨

| 用途 | 推奨モデル | 思考モード |

|---|---|---|

| 画像認識(日常利用) | Gemma 4 26B | OFF |

| 複雑な画像推論 | Gemma 4 26B | ON |

| テキスト生成(高速) | Qwen 3.5 35B(mlx_lm.server経由)67tok/s | OFF |

| コーディング | Qwen 3.5 35B(mlx_lm.server経由)68tok/s | ON |

関連リンク

- Gemma 4 26B (MLX) – HuggingFace

- Qwen 3.5 35B (MLX) – HuggingFace

- vllm-mlx – GitHub

- mlx-vlm – GitHub

コメント